Стивен Хокинг Ескерту: Болашақты болжаған фактісі

Стивен Хокингнің даңқы General Relativity және Black Holes-те жасалған зерттеуге негізделген. Бірақ ол жиі алдағы онжылдықта адамзатқа үлкен қиындықтар мен қауіп-қатерлерге тап болғандарын атап көрсету үшін өзінің зерттеуінен тыс жерлерге жиі шығып жүрді. Оның ескертулері бұқаралық ақпарат құралдарындағы тақырыптар болды, кейде ол қайшылық тудырды.

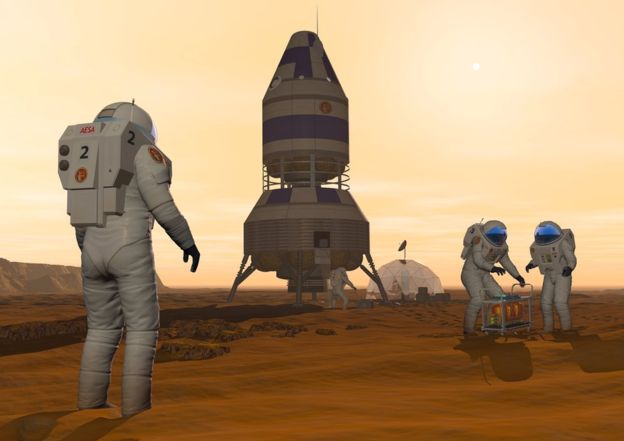

Жерден кету

Хокинг барлық жұмыртқаларды бір қоржынға — Жерден себетке салып қойғанымызға қатты алаңдатты. Ондаған жылдар бойы Хокинг адамдарға басқа планеталарға тұрақты түрде көшу процесін бастауға шақырады. Ол қайта-қайта жаңалықтарды жариялайды.

Хакингтің негіздемесі адамзат кейде апаттан зардап шегеді — кейінірек емес, ертерек. Оның төменгі ықтималдығы, жоғары әсер ету оқиғасы деп аталатыны — біздің планетамызға ұшыраған үлкен астероид классикалық мысал. Бірақ Hawking басқа жасанды интеллект, климаттың өзгеруі, вирустар, ГТО және ядролық соғыс сияқты көптеген басқа әлеуетті қауіп-қатерге ұқсайды.

2016 жылы ол Би-Би-Сиге былай деді: «Жердегі планетаның апатқа ұшырау ықтималдығы өте төмен болуы мүмкін, ол уақытты қосады және келесі мыңдаған немесе 10 000 жылда ол дерлік сенімді болады.

Ол адамдар осы уақытқа ғарышқа бөлінетініне сенімді болғанымен, «біз ғарышта кем дегенде келесі жүз жыл ішінде өзімізді ұстайтын колониялар құрмаймыз, сондықтан осы кезеңде өте мұқият болуға тиіспіз».

Мұнда Хоукиннің көзқарасы, басқа да супер-жұлдыздар ғылымының кәсіпкері Элон Масктың қызметіне сәйкес келеді, оның ойлары кең назар аударады. 2013 жылы Маска конференцияларда: «Біз басқа планеталарға жерді тараттық, немесе біз жоғалу қаупі бар», — деп мәлімдеді. Өрттену сөзсіз, және біз өзімізді өзіміз жасаймыз.

Осы мәселе бойынша өз ойларына сәйкес, Хокинг сонымен қатар ғаламшар аралық саяхатқа арналған технологияларды зерттейтін жобаға өз атауын берді — «Старшиндік бастама» старшестігі.

Машиналардың өсуі?

Хокинг жасанды интеллект саласындағы жетістіктерден туындаған үлкен мүмкіндіктерді таниды және қауіп туралы ескертті.

2014 жылы ол BBC-ге «толыққанды жасанды интеллекттің дамуы адамзаттың жойылуын білдіре алады» деп айтты.

Хокинг жасанды интеллекттің примитивтік формаларын біледі, әзірге әзірге дамыған өте пайдалы; Оның үстіне, ол техникалық түрде жасанды интеллекттің негізгі түрін байланыстыру үшін үйренген. Бірақ Хокинг адамды салыстыра алатын немесе шығаратын жасанды интеллекттің қазіргі заманғы нысандарының салдарынан қорқады.

Кейбір ғалымдар түсініктемелер ескірген ғылыми фитнестің тректеріне негізделген деп ойлады. Басқа адамдар, мысалы, профессор Брэдли махаббат, ұлы сияқты, мүмкін қауіптер туралы келісті: «ақылды AI қоғам үшін мол байлық жасайды, бірақ көптеген адамдар жұмыссыз қалдырады», — деді ол әңгіме барысында.

Бірақ ол: «Егер адамзат болашағына алаңдамайтын болсақ, біз АИ роботтарының талапкері емес, климаттың өзгеруі және жаппай қырып-жоятын қару сияқты нақты проблемаларға назар аударуымыз керек» деді.

http://www.bbc.com